OpenClaw en contenedor LXC

Ya hemos visto las ventajas y desventajas de usar contenedores LXC con respecto a máquinas virtuales en una infraestructura Proxmox.

Cada vez es más habitual montar entornos de IA en casa o en laboratorio, y herramientas como OpenClaw permiten aprovechar ese potencial sin depender de servicios externos. El problema viene cuando tienes que decidir cómo desplegarlo, ¿máquina virtual tradicional o contenedor?

En este caso vamos a apostar por contenedores LXC en Proxmox, una opción mucho más ligera y eficiente en consumo de recursos. La ventaja es clara, menos overhead (sobrecostes de computación), arranque rápido y mejor aprovechamiento del hardware, especialmente cuando hablamos de GPUs para acelerar cargas de trabajo de IA.

Ahora bien, no todo es perfecto. Los contenedores LXC no están diseñados específicamente para workloads con GPU, y eso implica lidiar con permisos, acceso a dispositivos como "/dev/dri" (Direct Rendering Infrastructure) y ciertas limitaciones frente a una VM completa. Aun así, si sabes lo que estás haciendo, puedes conseguir un entorno muy potente y optimizado.

En este tutorial vamos a montar OpenClaw sobre Ubuntu 25 dentro de un LXC en Proxmox, conectando una GPU AMD y dejando el sistema listo para trabajar con IA de forma eficiente. Adicionalmente, usaremos Ollama como Backend.

¿Qué es OpenClaw?

OpenClaw es una plataforma de ejecución y orquestación ligera para cargas de trabajo de inteligencia artificial, orientada a entornos on-premise o self-hosted. Permite desplegar y gestionar modelos de IA optimizando el uso de recursos hardware, con especial énfasis en aceleración por GPU. Su enfoque modular y flexible la hace especialmente útil en homelabs, entornos de testing o despliegues controlados fuera del cloud.

Configuración en el Host (Proxmox)

Antes de tocar el contenedor, es imprescindible validar que el host reconoce correctamente la GPU AMD y está utilizando el driver adecuado (amdgpu):

Verificar detección de la GPU

Ejecuta:

lspci -nnk | grep -i vga -A3Deberías ver algo como "Kernel driver in use: amdgpu"

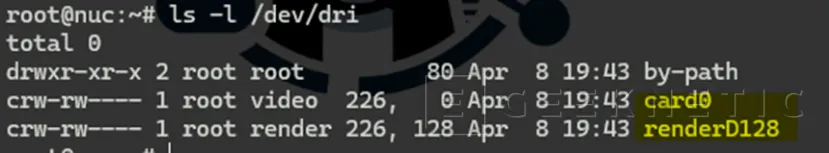

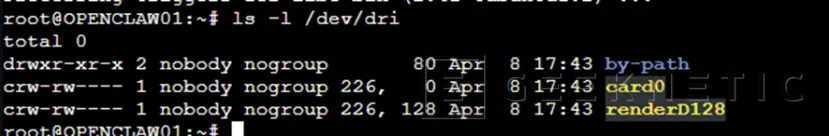

Verificación de dispositivos DRM (Direct Rendering Manager)

Comprueba que los dispositivos gráficos están expuestos:

ls -l /dev/driDeberías ver card0 y renderD128. Si aparecen, ¡ya tienes el 50% del trabajo hecho!

Si estos dispositivos existen, el host está correctamente preparado y puedes continuar. Este punto es crítico, sin /dev/dri, no hay GPU en LXC.

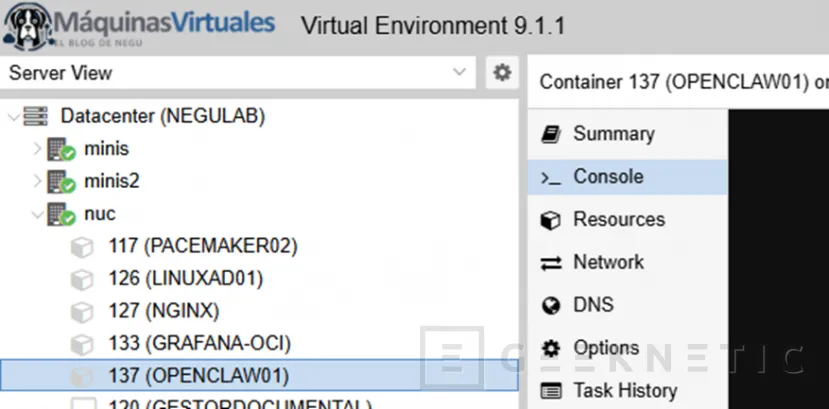

Configuración del Contenedor LXC

Ahora que el host ve la GPU, vamos a "pasársela" al contenedor Ubuntu 25.04. Para ello, exponemos la GPU al contenedor.

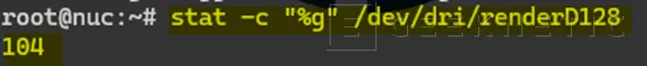

Obtener el GID del dispositivo render

En el host ejecuta:

stat -c "%g" /dev/dri/renderD128Normalmente devolverá un número (ej. 104 o 106):

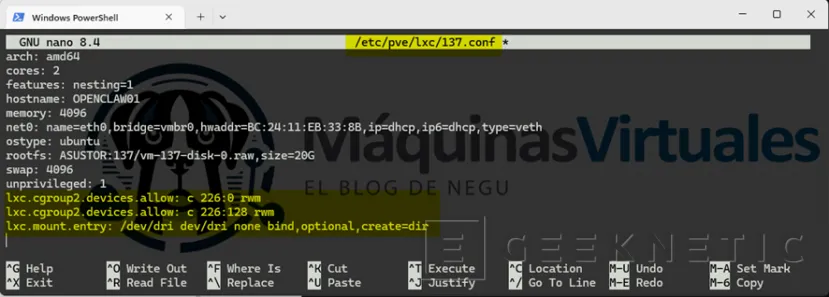

Editar configuración del contenedor

Sustituye 137 por tu ID:

nano /etc/pve/lxc/137.conf

Añade al final:

# Acceso a GPU AMDlxc.cgroup2.devices.allow: c 226:0 rwm

lxc.cgroup2.devices.allow: c 226:128 rwm

lxc.mount.entry: /dev/dri dev/dri none bind,optional,create=dir

Esto hace tres cosas clave:

- Permite acceso a dispositivos DRM

- Expone /dev/dri dentro del contenedor

- Evita bloqueos por cgroups

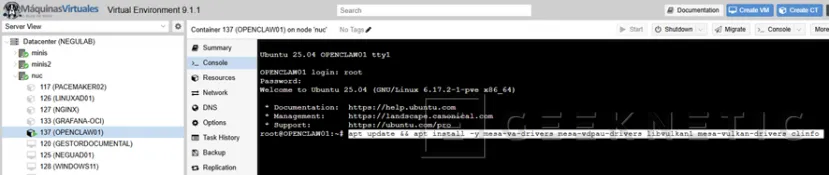

Configuración dentro del LXC (Ubuntu 25.04)

Arranca el contenedor y entra en la consola:

Instalar librerías gráficas necesarias

apt update && apt install -y \mesa-va-drivers \mesa-vdpau-drivers \

mesa-vulkan-drivers \libvulkan1 \libgl1-mesa-dri \clinfo

Verificar acceso a GPU

ls -l /dev/dri

Si falla:

- Revisa permisos

- Revisa montaje /dev/dri

- Revisa config LXC

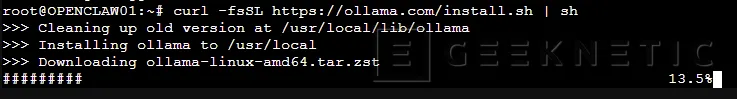

Backend con Ollama

Para que el laboratorio sea realmente funcional, un paso crítico es asegurar que Ollama (que será el cerebro de tu OpenClaw) detecte la GPU AMD dentro de ese contenedor Ubuntu 25.04 y tiene que estar instalado previamente a OpenClaw si lo vamos a usar como Backend. Sin esto, todo irá por CPU y será desesperadamente lento.

Instalar dependencias mínimas

Como estamos en un contenedor y queremos "gasto cero", no necesitamos el stack completo de ROCm de 20GB. Instalaremos solo lo necesario para que OpenClaw/Ollama hablen con la Radeon:

sudo apt updatesudo apt install -y libnuma1 clinfo zstdInstalar Ollama en el contenedor

Ejecuta el instalador oficial. En 2026, Ollama ya tiene un soporte excelente para gráficas "Beige Goby" (la nuestra):

curl -fsSL https://ollama.com/install.sh | sh

Verificar GPU AMD

Este es el momento de la verdad. Ejecuta:

ollama serveEn los logs iniciales debería aparecer una línea que diga amdgpu, detected GPU o algo similar a Radeon RX 6600. Si solo ves CPU, revisa que el paso de /dev/dri del host al LXC esté correcto.

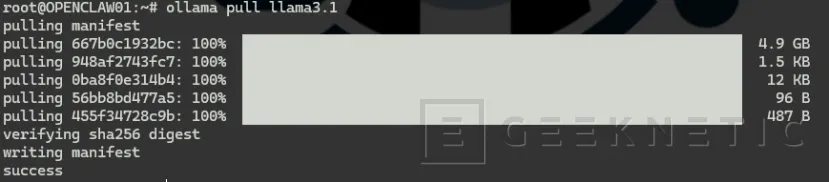

Vincular OpenClaw con Ollama

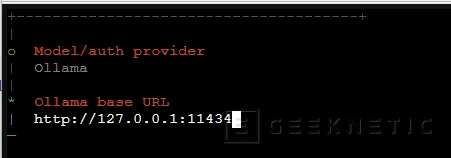

Cuando abras la interfaz de OpenClaw por primera vez (normalmente en el puerto 3000), ve a Settings > Provider y configura lo siguiente:

- Provider: Ollama

- Base URL: http://localhost:11434

- Model: Elige llama3.1:8b (es el estándar de oro para laboratorios gratuitos hoy en día).

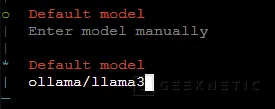

Lanza: "ollama pull llama3.1"

Instalación de OpenClaw

Con la GPU operativa y Ollama instalado, ya puedes proceder a instalar OpenClaw. Al ser una GPU AMD moderna (RDNA 2), el rendimiento en el contenedor será excelente ya que utiliza los drivers nativos del kernel.

Instalamos Curl en el LXC si no está presente

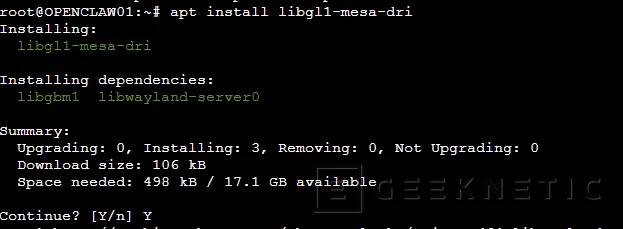

apt install curl** Nota importante: En este ejemplo, estamos usando Ubuntu 25.04, que es muy reciente. Si tienes errores de librerías .so, asegúrate de disponer del siguiente paquete (si has seguido el manual ya debe estar instalado):

apt install libgl1-mesa-driEste paquete es clave para la comunicación con la GPU.

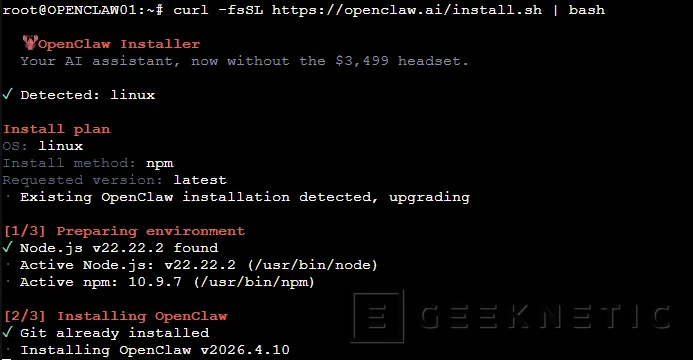

Ejemplo de instalación rápida de OpenClaw

A diferencia de otras instalaciones, el instalador de OpenClaw no es completamente automático, de hecho te va a pedir varias decisiones importantes.

curl -fsSL https://openclaw.ai/install.sh | bash

Opciones del instalador (qué elegir y por qué)

Cuando lances el script, verás varias opciones. Aquí tienes lo que debes seleccionar en este escenario:

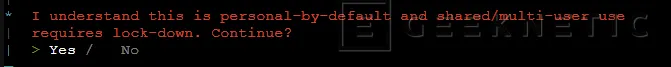

Security Warning: Confirmar el Riesgo

- Selección: Yes

- Por qué: Al estar en un LXC (Linux Container), ya tienes una primera capa de aislamiento respecto al host de Proxmox. Sin embargo, dentro del contenedor, el agente tendrá los permisos del usuario que lo ejecute (en tu caso, parece que vas como root).

- Recomendación: Una vez termines la instalación, considera no ejecutar el servicio de OpenClaw como root, sino crear un usuario sin privilegios de sudo para limitar qué podría hacer el bot.

¿Por qué elegir QuickStart en tu entorno (LXC Proxmox)?

- Agilidad en el Contenedor: Al estar en un LXC con Ubuntu 25, lo más probable es que quieras ver primero si el orquestador arranca correctamente y detecta el entorno antes de pelearte con la configuración manual de bases de datos o conectores complejos.

- Configuración Posterior: OpenClaw permite lanzar el comando openclaw configure en cualquier momento. Esto es vital para ti porque, al tener una GPU AMD, después querrás mapear específicamente los parámetros de aceleración (ROCm) o apuntar a un backend de inferencia local (como Ollama) de forma quirúrgica.

- Evitar Bloqueos de Red: El modo manual suele pedirte tokens de API y configuraciones de red que, si fallan durante el script de instalación, pueden dejar el servicio en un estado inconsistente. Con el QuickStart, el instalador terminará de desplegar los binarios y el entorno Node.js sin interrupciones.

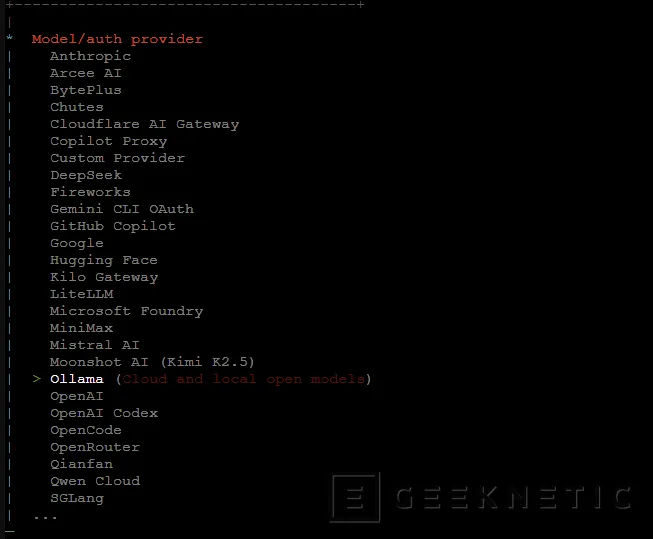

Seleccionamos Ollama

- Integración Local: Al seleccionar Ollama, OpenClaw intentará conectarse al servidor de inferencia que corre en tu misma máquina (o contenedor). Por defecto, buscará la URL http://localhost:11434.

- Aprovechamiento de la GPU AMD: OpenClaw no "gestiona" la GPU directamente, es Ollama quien lo hace.

- Arquitectura: OpenClaw actuará como el "cerebro" (el agente que decide qué hacer) y Ollama será el "músculo" (el que genera el texto usando tu hardware).

Dejamos la URL:

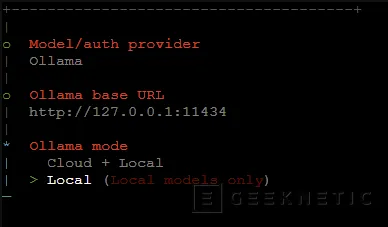

¿Por qué elegir "Local"?

- Soberanía de datos: Todo lo que escribas o los archivos que OpenClaw analice se procesarán exclusivamente dentro de tu contenedor Proxmox. Nada sale a servidores externos.

- Aprovechamiento del hardware: Tienes una GPU AMD configurada específicamente para esto. Usar modelos locales justifica el esfuerzo técnico que has hecho con el passthrough en Proxmox.

- Sin costes: No necesitas pagar suscripciones a Anthropic o OpenAI; estás usando tu propia electricidad y silicio.

- Menor Latencia: Al estar OpenClaw y Ollama en el mismo "segmento" (localhost), la comunicación es instantánea.

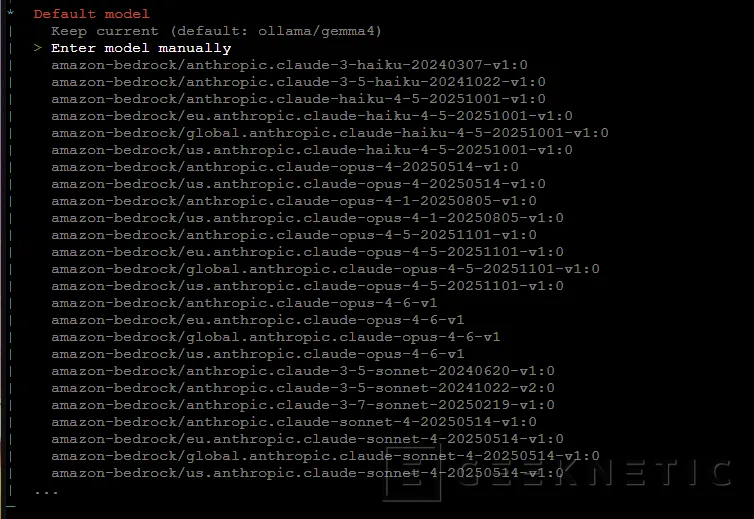

¿Por qué elegir "Enter model manually"?

Aunque veas ollama/gemma4 (o similares) en la lista, lo mejor es escribir exactamente el modelo que has descargado (o vas a descargar) en tu instancia local de Ollama para asegurarte de que la conexión es directa y sin confusiones con modelos en la nube.

Qué hacer al seleccionar esta opción:

- Elige Enter model manually.

- Escribe: ollama/llama3 (o el nombre del modelo que hayas bajado con ollama pull).

Nota: En OpenClaw, el formato suele ser provider/model-name.

Recomendación según tu GPU AMD:

- Si tienes 8GB de VRAM o menos: Usa ollama/llama3 o ollama/mistral.

- Si tienes 16GB de VRAM o más: Puedes probar con ollama/gemma2:27b o incluso ollama/llama3:70b (aunque este último irá más lento).

- Para tareas de código: ollama/qwen2.5-coder:7b es una joya que vuela en local.

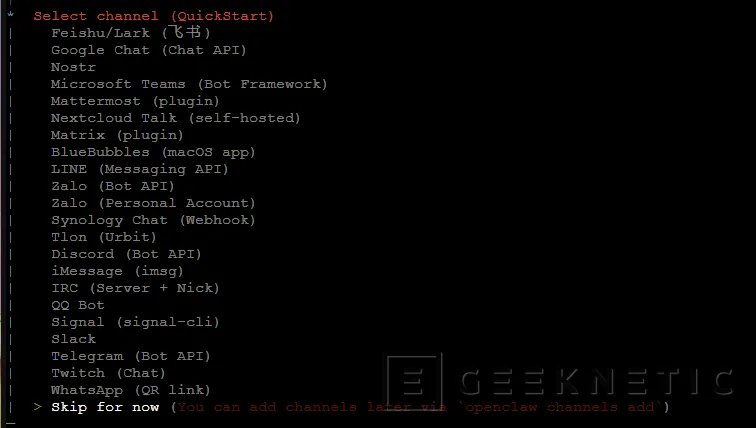

Elegir Skip for now

Aunque es probable que usemos Telegram o Whatsapp finalmente, usaré la opción Skip for now inicialmente. Esto lo hago porque:

- Aislamiento: Te aseguras de que el motor (Ollama + GPU AMD) y el orquestador (OpenClaw) se entienden correctamente antes de meter la complejidad de las APIs de mensajería o problemas de red externos.

- Prueba en caliente: Podrás ejecutar comandos de prueba directamente desde la terminal de tu LXC para verificar que la GPU AMD está haciendo el trabajo pesado (inferencia) y no la CPU del host Proxmox.

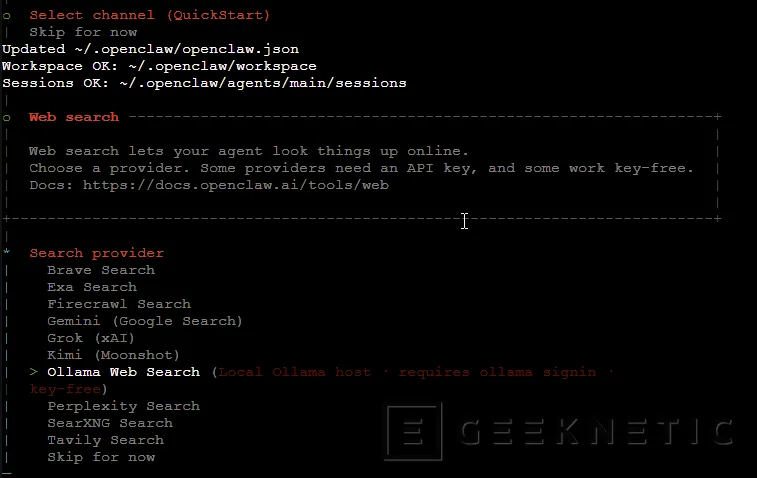

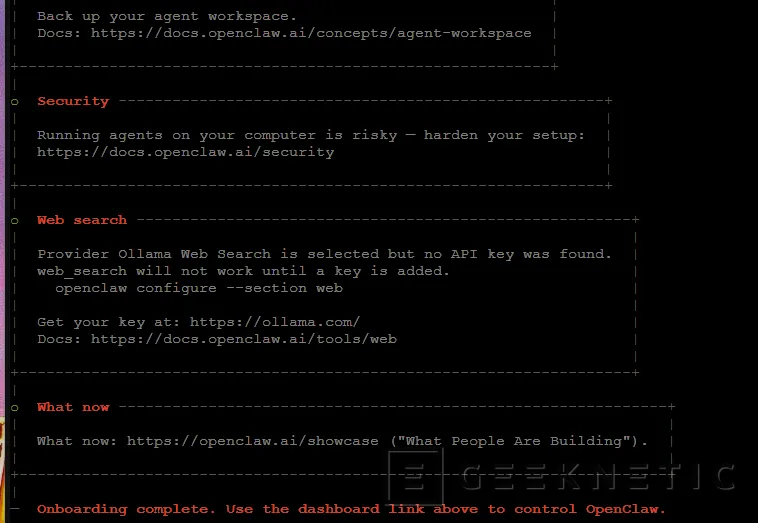

Seleccionamos Ollama Web Search

- Soberanía Total (Local-First): Al igual que con el modelo de lenguaje, esta opción intenta mantener el flujo de trabajo lo más privado posible. Aprovecha que ya tienes Ollama corriendo en tu LXC.

- Key-free (Sin tarjetas de crédito): A diferencia de Tavily o Perplexity, que suelen pedir una API Key (y eventualmente cobrarte), esta opción está diseñada para funcionar sin fricción inicial.

- Consistencia: Mantienes todo el ecosistema dentro de lo que ya has configurado en tu contenedor de Proxmox.

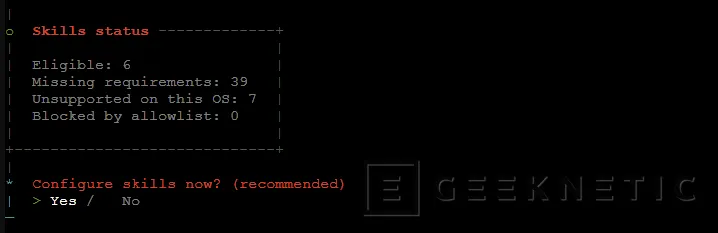

Pulsamos Yes para Skills

- Potencia del Agente: Si no activas las habilidades, tienes un simple chatbot. Al activarlas, conviertes el contenedor en una estación de trabajo donde el bot puede ayudarte con tareas reales de administración de sistemas.

- Aprovechar Ubuntu 25: Al estar en una versión tan reciente, es interesante ver qué habilidades son compatibles y cuáles no (esas "Unsupported on this OS" que menciona).

- Control de riesgos: El instalador te dejará elegir cuáles activar. Podrás darle permiso para leer archivos pero quizás no para borrar cosas, manteniendo la seguridad de tu entorno.

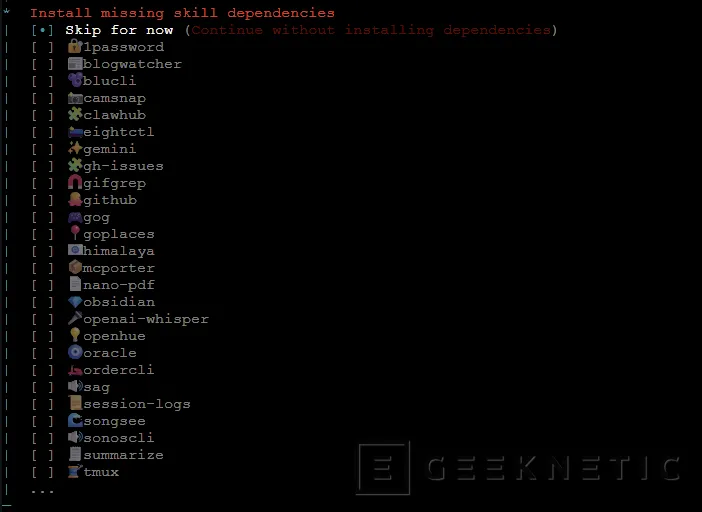

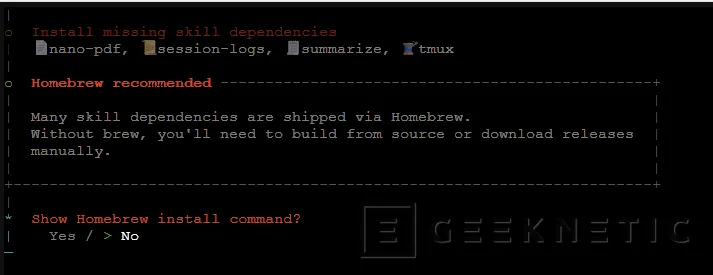

Skills seleccionadas

Las seleccionamos con el tabulador, las mínimas para mi uso inicial:

- session-logs: Vital para que el agente pueda recordar y analizar lo que ha pasado en sesiones anteriores. Muy útil para depurar si algo falla en el LXC.

- summarize: Perfecta para cuando le pases logs largos de Proxmox o archivos de configuración extensos, te ahorrará mucho tiempo de lectura.

- tmux: Altamente recomendada. Al estar en un servidor/LXC, tmux permite que el agente gestione sesiones persistentes. Si el agente lanza un proceso largo, no se morirá si se corta la conexión.

- nano-pdf: Útil si piensas subirle documentación técnica en PDF para que la analice (como manuales de hardware AMD o de Proxmox).

Homebrew "No"

- Conflictos con APT: Ubuntu tiene uno de los repositorios más grandes del mundo (apt). Instalar Homebrew (que es un gestor de paquetes pensado originalmente para macOS) en un contenedor de Linux suele crear conflictos de rutas, duplicar binarios y llenar el disco innecesariamente.

- Rendimiento del LXC: Los contenedores LXC brillan cuando son ligeros. Homebrew instala sus propias dependencias en /home/linuxbrew, lo que aumenta el tamaño del backup de tu contenedor en Proxmox.

- Seguridad: Como sysadmin, prefieres gestionar tus binarios mediante apt o descargando el .deb oficial. Si una skill de OpenClaw necesita algo, es mejor instalarlo manualmente con apt install para tener control total sobre lo que corre en tu sistema.

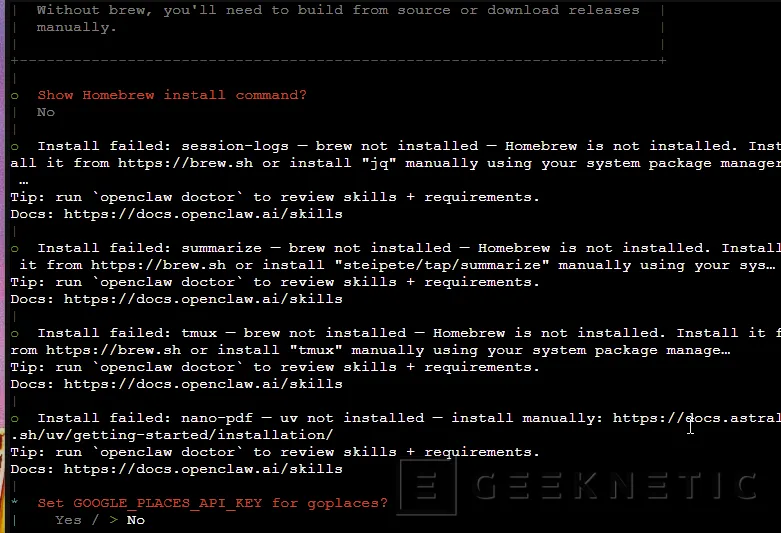

¿Qué está pasando con las Skills?

El instalador te está diciendo exactamente qué le falta a cada una. En un LXC de Ubuntu 25, es mucho mejor instalar esto por tu cuenta que meter Homebrew:

- Para session-logs: Solo necesitaremos "apt install jq".

- Para tmux: Solo necesitaremos apt install tmux.

- Para nano-pdf: Te pide uv (un gestor de paquetes de Python ultra rápido), que se instala con un comando simple.

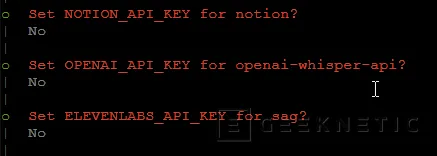

¿Por qué decir "No" a Google Places?

- Privacidad y Coste: Requiere una API Key de Google Cloud y, a menos que quieras que el bot busque restaurantes o locales físicos en Google Maps, no te sirve de nada en un servidor de infraestructura.

Elegimos NO para el resto de opciones:

Hooks "Skip for now"

- Los Hooks son automatizaciones que se disparan ante ciertos eventos (como al iniciar el bot o resetear una sesión). En tu entorno actual de "laboratorio" con Ubuntu 25 y GPU AMD, lo que te interesa es la estabilidad:

- Evitar procesos fantasma: Algunos hooks como session-memory intentan escribir y resumir sesiones constantemente. Si el modelo local (llama3) está ocupado procesando una respuesta pesada, los hooks podrían encolarse y hacer que el bot parezca "colgado".

- Depuración limpia: Si algo falla al principio, es más fácil saber por qué si no hay automatizaciones ejecutándose por detrás.

- Configuración manual posterior: Una vez que compruebes que el bot responde rápido usando tu GPU, puedes activar session-memory (que es el más útil para que el bot no olvide de qué estabais hablando) simplemente editando el JSON o con openclaw configure.

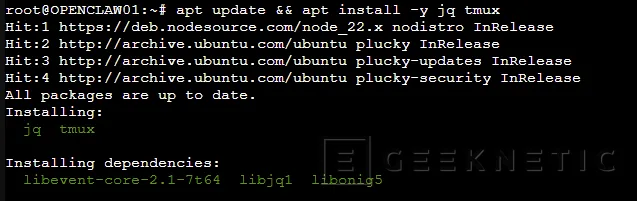

Terminamos el instalador y lanzaremos:

apt update && apt install -y jq tmux

Arrancar servicio OpenClaw

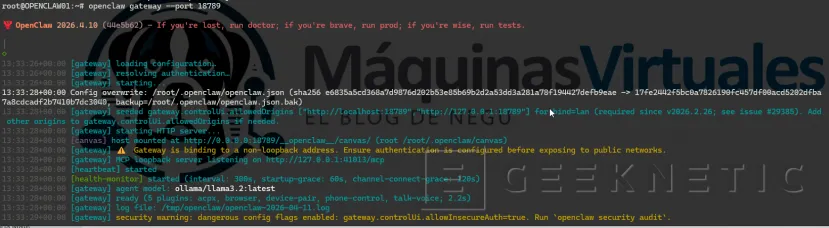

Usaremos el siguiente comando:

openclaw gateway --port 18789 --force

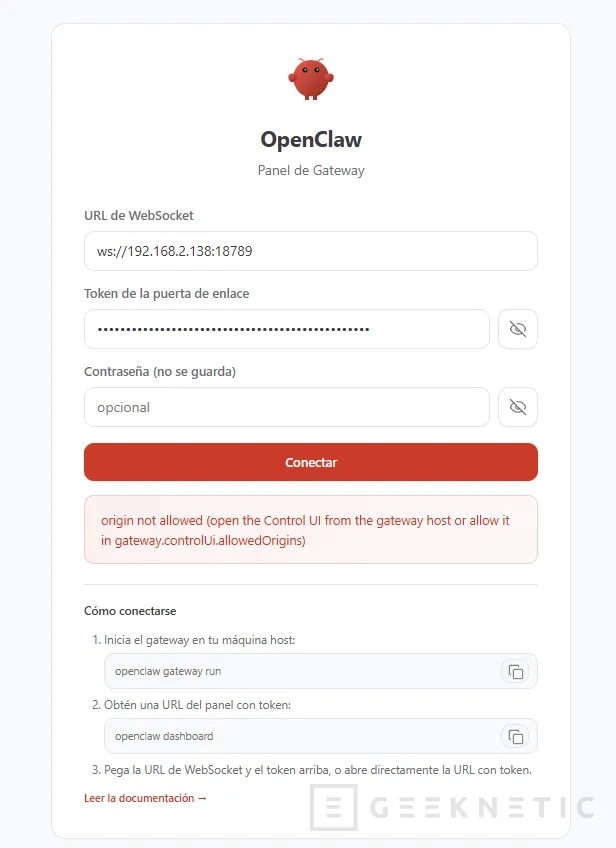

Y accedemos vía navegador al Chat:

http://IP-LXC:18789/ o http://IP-LXC:18789:TOKEN/

o vía terminal

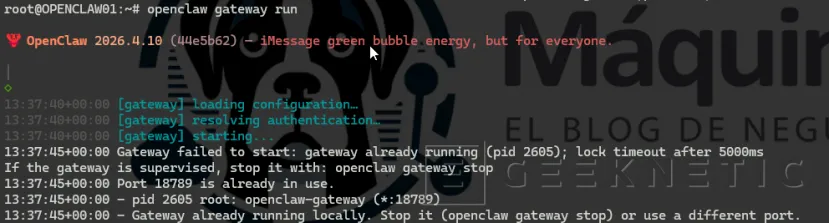

openclaw main sessionPara revisar logs:

root@OPENCLAW01:~# tail -f /tmp/openclaw/openclaw-2026-04-11.logEl gateway tiene que estar arrancado "openclaw gateway run":

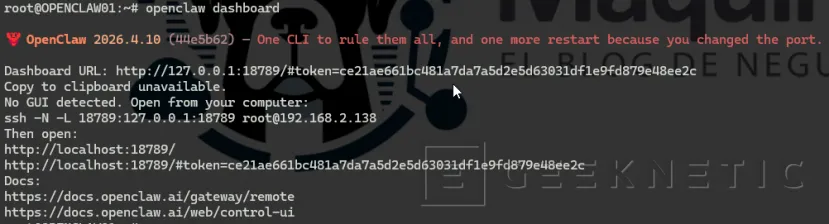

Para ver el token usaremos "openclaw dashboard":

Si necesitáis hacer otra validación podéis usar:

openclaw agent --message "test" --agent main

Probar si la GPU está en uso

Usaremos este comando, por ejemplo:

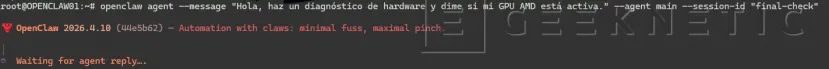

openclaw agent --message "Hola, haz un diagnóstico de hardware y dime si mi GPU AMD está activa." --agent main --session-id "final-check"

Truco Pro: El "Mode: Lab-Isolated"

Si quieres que OpenClaw no intente conectarse a nubes externas y se mantenga 100% local:

- Crea un archivo .env en la carpeta de instalación de OpenClaw.

- Añade:

OPENCLAW_MODE=local

OLLAMA_KEEP_ALIVE=24h

DISABLE_TELEMETRY=true

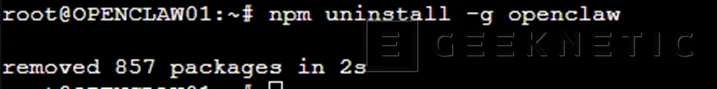

Desinstalación si fue vía NPM

Si lo instalaste como una herramienta de Node.js, usa este comando:

sudo npm uninstall -g openclawSi eso no funciona, intenta sin el sudo si tu usuario tiene permisos.

Borrar rastros del sistema

Aunque borres el comando, las configuraciones de tu laboratorio (llaves, bases de datos locales, etc.) se quedan guardadas en carpetas ocultas. Para borrar todo rastro:

rm -rf ~/.openclaw

Aprovecha tu GPU AMD en Proxmox

Después de este setup, ya no estás simplemente ejecutando OpenClaw, has montado un entorno de IA completo, optimizado y autocontenido sobre Proxmox usando LXC.

La clave aquí no ha sido solo instalar herramientas, sino entender cómo encajan:

- OpenClaw como interfaz y orquestador

- Ollama como motor de inferencia

- GPU AMD como acelerador real

- LXC como capa ligera de ejecución

Sí, tiene más fricción que una VM tradicional, y sí, hay que entender cómo funciona el acceso a hardware en contenedores. Pero una vez superas esa barrera, el resultado es mucho más eficiente en consumo de recursos y perfectamente válido para un laboratorio serio de IA en local.

Y lo más importante, a partir de aquí ya no dependes de nadie. Tienes un stack de IA completamente tuyo, funcionando en tu infraestructura, con coste de API cero y total control.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!